NVIDIA a pris une décision stratégique en s’associant avec Nanya Technology, basée à Taïwan, pour sa plateforme révolutionnaire Vera Rubin dédiée à l’intelligence artificielle. Dans le cadre de ce partenariat, Nanya fournira les mémoires LPDDR5X essentielles aux nouveaux systèmes Agentic AI de NVIDIA.

Avec cette collaboration, Nanya devient le premier fabricant taïwanais à intégrer la chaîne d’approvisionnement principale de NVIDIA, offrant une alternative aux dominations coréenne et américaine dans le secteur. La nouvelle plateforme devrait tripler la capacité par rapport aux serveurs Grace Blackwell précédents et augmenter la bande passante de plus de 50 %.

Renforcement de la chaîne d’approvisionnement et diversification avec Nanya

Face à l’évolution rapide des technologies d’intelligence artificielle, NVIDIA vise à renforcer la résilience de sa chaîne d’approvisionnement en matériel. La plateforme Vera Rubin nécessite deux types de mémoire : la HBM4 DRAM à haute bande passante pour les GPU Rubin et la DRAM LPDDR5X écoénergétique pour les CPU Vera. Alors que Samsung, SK Hynix et Micron dominent la production de HBM4, le marché de la LPDDR5X offre un éventail plus large de fournisseurs.

NVIDIA applique une gestion stratégique des risques en ouvrant ses portes aux fabricants taïwanais afin de réduire sa dépendance sur le marché mondial des mémoires. L’inclusion de Nanya dans ce processus montre que Taïwan s’affirme non seulement dans les domaines de la fonderie et du packaging, mais aussi dans les technologies de mémoire.

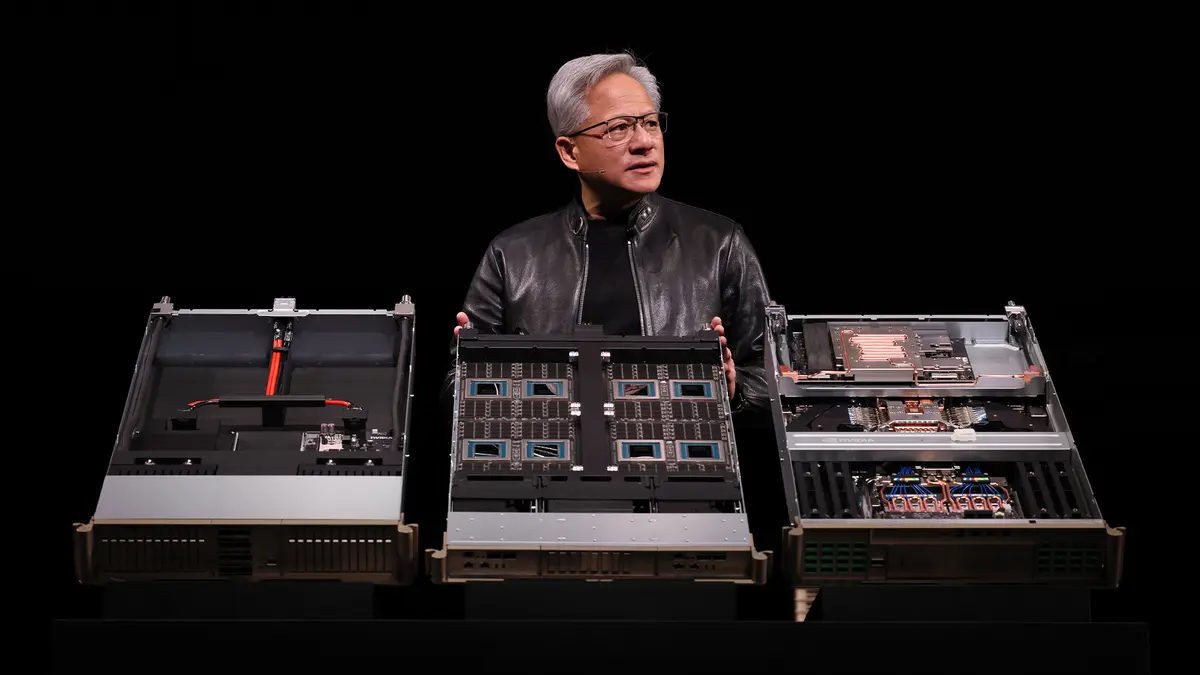

Améliorations révolutionnaires avec la plateforme Vera Rubin

La plateforme Vera Rubin promet des améliorations révolutionnaires en termes de capacité de traitement pour l’intelligence artificielle. Chaque super puce Vera Rubin sera équipée d’une mémoire de 1,5 To fonctionnant à une vitesse de 1,2 To/s.

Ces chiffres représentent un bond énorme par rapport aux systèmes Grace Blackwell précédents. Dans des solutions d’intelligence artificielle à l’échelle du rack, l’assemblage de 256 puces Vera pourrait atteindre jusqu’à 400 To de mémoire et une bande passante totale allant jusqu’à 315 To/s.

La plateforme Vera Rubin augmentera considérablement la vitesse de traitement des grands modèles linguistiques grâce à un triplement de la capacité mémoire. Alors que les modèles Agentic AI se généralisent, le transfert de charge des GPU vers les CPU nécessite davantage de capacité mémoire malgré les avancées en technologies de compression des données.

NVIDIA prévoit répondre à cette demande massive en collaborant avec des partenaires comme Nanya pour consolider son leadership sur le marché de l’intelligence artificielle.